人工智能工具,将文本转换为自然声音的语音。

F5-TTS 是一款由上海交通大学开源的强大文本到语音(TTS)合成系统,具有以下特点和功能:

核心优势:

– 超高还原度:克隆出的声音与原音色极其相似,专业人士都难以分辨。

– 快速克隆:仅需 10 到 15 秒左右的音频样本就能生成克隆语音。

– 多语言支持:能够自如地切换不同语言,甚至支持中英文混排的文本生成。

– 语速控制:可精准调节生成语音的速度,满足不同场景的需求。

– 情感表达:根据文本内容自动生成带有相应情感的语音,使输出更加自然。

– 用户友好:提供直观的可视化管理界面,操作简单易上手。

– 灵活部署:既可以在线使用,也支持本地部署,兼顾便捷性和隐私保护。

主要功能:

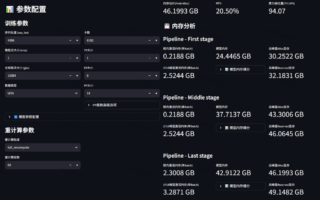

基础语音克隆:用户上传一段原音频,输入想要生成的文本,就可一键生成克隆语音。系统提供 F5-TTS 和 E2-TTS 两种模型选择,其中 F5-TTS 使用 ConvNeXtV2 扩散模型,训练和推理速度更快;E2-TTS 采用平面 unet 变换器,音色还原度更高。还可通过高级设置调整语速、去除静音等参数以获得最佳效果。

播客生成:可添加多个发言人,为每个发言人设置不同的音色,然后输入对话脚本,系统就能生成逼真的多人对话音频。

多种语音类型生成:支持根据文本语义自动识别并调用不同情绪的音频样本,从而生成带有丰富情感表达的语音。用户可上传各种情绪类型的音频样本,如开心、生气、失落等,系统会根据文本内容自动选择合适的情绪音色。

技术原理:

– 采用流匹配(Flow Matching)目标训练模型,将简单的概率分布转换为复杂的概率分布。

– 以扩散变换器(DiT)作为核心网络,处理序列数据,逐步去除噪声,生成清晰的语音信号。

– 利用 ConvNeXt V2 改进文本表示,提升语音合成的质量和自然度。

– 在推理时采用 Sway Sampling 策略,这是一种非均匀采样,提高模型的性能和效率。

– 端到端系统设计,简化从文本输入到语音输出的过程,省略了传统的复杂设计。

安装和使用方法:

– 本地部署:

– 安装前提条件:确保电脑上已安装 git 和 conda。

– 克隆项目:使用 git 命令克隆 F5-TTS 项目到本地。

– 创建虚拟环境:使用 conda 创建并激活专门的 python 环境。

– 安装 pytorch:根据自己的 cuda 版本安装适合的 pytorch 版本。

– 安装项目依赖:使用 pip 安装项目所需的所有依赖包。

– 安装管理界面:运行指定命令安装 gradioapp 管理界面。

– 在线体验:上传原始音色音频,输入需要转成语音的文本,即可生成带预期音色的音频。

– 推理方式:

– Gradio 应用:启动 Gradio 应用进行 GUI 推理,可指定端口/主机或生成分享链接。

– CLI 推理:通过命令行运行,指定模型、参考音频、参考文本和要生成的文本等参数,也可使用配置文件指定参数,支持多语音生成。

– **应用场景**:涵盖有声读物、虚拟助手、视频配音、教育培训、客户服务、娱乐产业、辅助医疗等多个领域。

评论 ( 0 )